Mit Künstlicher Intelligenz Desinformationen zu Gesundheitsthemen erkennen und bekämpfen. In einer dynamisierten und digitalen Informationsgesellschaft werden oftmals Informationen veröffentlicht, die leider unwahre Behauptungen beinhalten. Im Projekt „VERITAS – VERIfication through Trusted ASsociation“ wird daher ein intelligentes und selbstlernendes System entwickelt, welches sowohl Desinformationen (“Fake News“) zuverlässig, schnell und automatisch erkennen kann, als auch ausreichend Hilfestellung bei der Interpretation dieser Informationen bietet.

Problem & Motivation

In einer dynamisierten und fortwährend sich beschleunigenden Informationsgesellschaft werden oftmals über Online-Medienplattformen Informationen veröffentlicht, ohne diese im Detail zu verifizieren. Ein Überangebot an stündlich sich aktualisierenden Informationen bietet dabei die Gefahr, dass einzelne Ausschnitte aus dem Nachrichtenfluss nur Teilwahrheiten beinhalten und diese im Anschluss über weitere Nachrichtenkanäle wie z.B. Social Media zusätzlich verfremdet werden. Dies kann zu einer fragwürdigen Informationsqualität von Nachrichten und Meldungen führen, bei der es ohne zuverlässige Quellen schwierig wird, zu identifizieren, welche Nachricht authentisch und welche fälschlicherweise überarbeitet ist.

Sind Fehlinformationen generell ein Problem für demokratische Gesellschaften, so gilt dies für das Gesundheitswesen im Besonderen. Die Corona-Krise wurde durch eine Vielzahl falscher und irreführender Meldungen begleitet. Aber auch die abweichende Interpretation medizinischer Quellen kann zu Verunsicherungen bei Patientinnen und Patienten führen.

Quelle: www.bmbf.de/fakenews

Projektziele und Projektinhalt

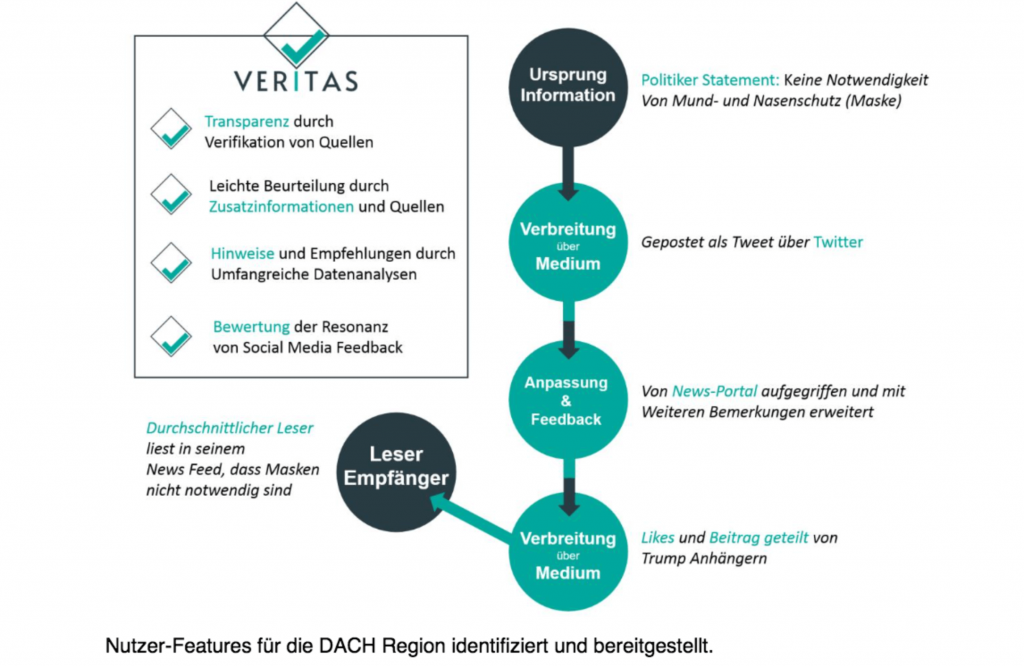

Im Projekt „VERITAS: VERIfication through Trusted ASsociation“ wird daher ein intelligentes, umfassendes und selbstlernendes System entwickelt, welches sowohl Desinformationen (“Fake News“) zuverlässig, schnell und automatisch erkennen kann, als auch ausreichend Hilfestellung bei der Interpretation dieser Informationen bietet. Das VERITAS-Konsortium entwickelt eine digitale Plattform, auf der deutschsprachige Nutzer*innen einzelne Nachrichten und Kommentare im Hinblick auf unterschiedliche Aspekte von Desinformationen überprüfen, sowie sich einen strukturierten, einheitlichen und individuellen Überblick über relevante kontroverse Meldungen seriöser Nachrichten-Redaktionen, Kommentare in sozialen Medien und vorhandenes Fach- und Expertenwissen verschaffen können.

VERITAS-Ziele sind:

- Stärkung der Transparenz und Verbreitung vertrauenswürdiger Quellen und validierter und gesicherter Fachinformationen für Gesundheitswesen,

- Konzeption intelligenter und selbstlernender Algorithmen zur Prüfung von Desinformation,

- Aufbau neuer, umfassender, themenspezifischer Big Data-Bestände verschiedenartiger Quellen,

- Entwicklung neuer linguistischer Methoden zur Analyse für den deutschsprachigen Raum sowie breitenwirksame,

- nutzerfreundliche Erkennung und Kommunikation von Desinformation.

Innovation und Breitenwirksamkeit

Das VERITAS-Vorhaben strebt an in seiner Datenbasis eine Vielzahl großer deutschsprachiger Datenbestände und verschiedenartiger Datenquellen, wie Nachrichtenportale, Fach- und Expertenportale und Social-Media-Kanäle zu integrieren und deren Informationsbestände zu validieren. Die Ergebnisse der VERITAS-konzeptspezifischen Such- und Desinformationserkennungsalgorithmen werden Nutzer*innen aufeinander bezogen veranschaulicht.

Darüber hinaus sorgt die VERITAS-Plattform auf Grundlage ihrer konzeptspezifischen Ranking-Algorithmen dafür, dass gerade die wichtigsten und auf ihren Informationsgehalt hin verifizierten Inhalte zuerst gesehen werden. VERITAS will somit einen allgemeinen Betrag dazu liefern, deutschsprachige Nutzer*innen vor Fehlinformationen zu schützen.

Im adressierten Anwendungsfall „Desinformation in der Corona-Krise“ soll besonders die digitale Gesundheitskompetenz von Bürgerinnen und Bürgern gefördert werden. Diese integrative Rolle von VERITAS in der Öffentlichkeit kann langfristig zu einem besseren Verständnis von Informationsqualität in der Gesellschaft beitragen und eine faktenorientierte, differenzierte Meinungsvielfalt innerhalb demokratischer Medien- und Gesellschaftsstrukturen stärken.

Fake News in der Corona Krise

Die Corona-Krise wurde durch massenhafte falsche und irreführende Meldungen („Fake News“) begleitet. Dadurch ausgelöst gab es über 800 Todesfälle und 5800 Krankhauseinweisungen. Als Reaktion darauf gaben im Februar 2020 mehr als zwei Dutzend Wissenschaftler*innen in der medizinischen Fachzeitschrift „The Lancet“ eine Erklärung ab: „Wir stehen zusammen, um Verschwörungstheorien, die darauf hindeuten, dass COVID-19 keinen natürlichen Ursprung hat, scharf zu verurteilen“. Anhänger von Verschwörungstheorien fördern Fehlinformationen darüber, dass das Virus nicht ansteckend ist, das Ergebnis von Labormanipulationen ist oder durch die Verteilung neuer Impfstoffe Gewinne erzielt. Die gefährlichste Auswirkung dieser weit verbreiteten Fehlinformation ist, dass sie die Einstellungen und Verhaltensweisen für vorbeugende Maßnahmen zur Eindämmung des Ausbruchs negativ beeinflusst.

Fehl- und bewusste Falschinformationen haben einen erheblichen Einfluss auf demokratische Gesellschaftsstrukturen. Gefälschte Nachrichten können als Folge des Boulevardjournalismus entstehen oder sie werden bewusst als gezielte Fehlinformation mit dem Ziel einer absichtlichen Desinformation oder Falschmeldung verbreitet. Genutzte Kanäle sind hierfür entweder traditionelle Print- und Rundfunknachrichtenmedien oder soziale Online-Medien. Im Gegensatz zu Massenkommunikationsmodellen der Vergangenheit, bei denen eine Nachrichten-Redaktion die alleinige Hoheit darüber hatte, was der Leser in der Zeitung lesen wird, veröffentlichen die Internetnutzer inkl. digitaler Bots heutzutage die Informationen selbst und sorgen mit ihrem Sharing- und Liking-Verhalten für neue Dynamiken. Weiterhin können digitale Bots automatisch generierte irreführende Informationen in sozialen Medien verbreiten.

Sind Fehlinformationen generell ein Problem für demokratische Gesellschaften, so gilt dies für das Gesundheitswesen im Besonderen. Als weiteres bekanntes Beispiel für die Verbreitung von Fehlinformationen im medizinischen Kontext sind impfgegnerische Äußerungen, und hier insbesondere bezüglich der Masernerkrankung, die auf einer längst zurückgezogenen Studie von Wakefield et al. (1998) basieren und zum Teil noch immer die Suchergebnisse im Internet anführen und für Bedenken der Eltern zur Notwendigkeit und Sicherheit der Impfung sorgen.

Einzelne Studien zeigen weiterhin, dass Twitter-Statusupdates Hinweise auf Missbrauch oder Missverständnisse von Antibiotika aufzeigen und fast jedes dritte YouTube-Video zur Magersucht diese Erkrankung begünstigt darstellt. Studien zeigen auch, dass gerade im medizinischen Bereich irreführende Videos und Videos zur Äußerung von Patientenmeinungen durch Internetnutzer*innen konsumiert werden.

Auch Pharmafirmen investieren zum Teil erheblich in die Online-Vermarktung ihrer Produkte. Bei Informationen zur Wirkungsweise von Arzneimitteln sind es bspw. übermäßiges Vertrauen in die Richtigkeit von Online-Informationen, Unwissenheit über den Einfluss von Pharmaunternehmen, soziale Isolation und Detailfixierung, die Internetnutzer für Fehlinformationen anfällig machen.

Vertrauenswürdige Quellen & Transparenz

Die VERITAS-Plattform ruft relevante Informationen automatisch über verschiedenste zentrale, digitale Plattformen ab. Diese beinhalten bekannte Nachrichtenportale, bspw. BILD, DIE ZEIT, Frankfurter Allgemeine Zeitung, Frankfurter Rundschau und Süddeutsche Zeitung, Fach- und Expertenportale, bspw. PubMed, Cochrane, Web of Science, Scopus and Google Datenbanken, und Social-Media-Kanäle, bspw. Facebook, Twitter, Instagram und Jameda. Die Vielfalt dieser Quellen bildet insgesamt eine umfassende Entscheidungsgrundlage zur Bewertung der Glaubwürdigkeit der konkret ausgewählten Nachricht.

Darüber hinaus werden die Nutzer*innen mit dem Vorhandensein der Kontroversität der Informationen zu ihrem Thema konfrontiert und somit bei der eigenständigen Erkennung gefälschter Nachrichten unterstützt. Gerade das Vorhandensein der Kontroversität der Informationen zum Thema hat einen positiven Einfluss auf die Erkennung gefälschter Nachrichten. Dagegen ist die Wirksamkeit von Warnmeldungen oder Flaggen derzeit unklar, während der Einsatz externer Faktenprüfer, bspw. durch Facebook, zwar dafür sorgt, dass die mit einem entsprechenden Hinweis markierten Fake News seltener mit anderen geteilt, jedoch aber auch dafür, dass diejenigen ohne entsprechenden Hinweis als glaubwürdiger eingestuft werden, selbst wenn es sich dabei um eine frei erfundene Nachricht handelt.

Im geplanten Projekt können qualitätsgeprüfte Social-Media-Bewertungen und Kommentare von Domänenexperten auch ein Mittel sein, wichtige Hinweise und Hilfestellungen in einer zugänglichen Sprache zu liefern, warum ein bestimmter Nachrichtenartikel gefälscht ist oder nicht. 88% der Verbraucher*innen vertrauen Online-Bewertungen genauso wie persönlichen Empfehlungen. Viele Transaktionen von Nachrichten finden überhaupt erst dann statt, wenn die ursprüngliche Nachricht gut bewertet wurde.

KI Prüfung von Desinformation

Im Zuge der kontinuierlichen Weiterentwicklung von Fehl- und Falschinformation sowie fragwürdigen Quellen verfolgt das VERITAS-Projekt den Ansatz, verschiedenste falsche oder fragwürdige Inhalte und Quellen automatisch zu erkennen und dies den Internetnutzer*innen transparent zu kommunizieren. Die VERITAS-Plattform inkl. ihrer zugrundeliegenden Algorithmen wird zudem unter Verwendung der neuesten Methoden aus NLP und Machine Learning entwickelt. Aufgrund der hohen Entwicklungsdynamik des Internets soll die VERITAS-Lösung in der Lage sein, sich fortwährend zu verbessern bzw. selbst zu lernen. Damit wird auch das Problem der mangelnden Zeit und Umständlichkeit einer umfangreichen Internetrecherche gelöst, die häufig dazu führt, dass Internetnutzer Nachrichten gar nicht erst auf ihre Desinformation hin überprüfen.

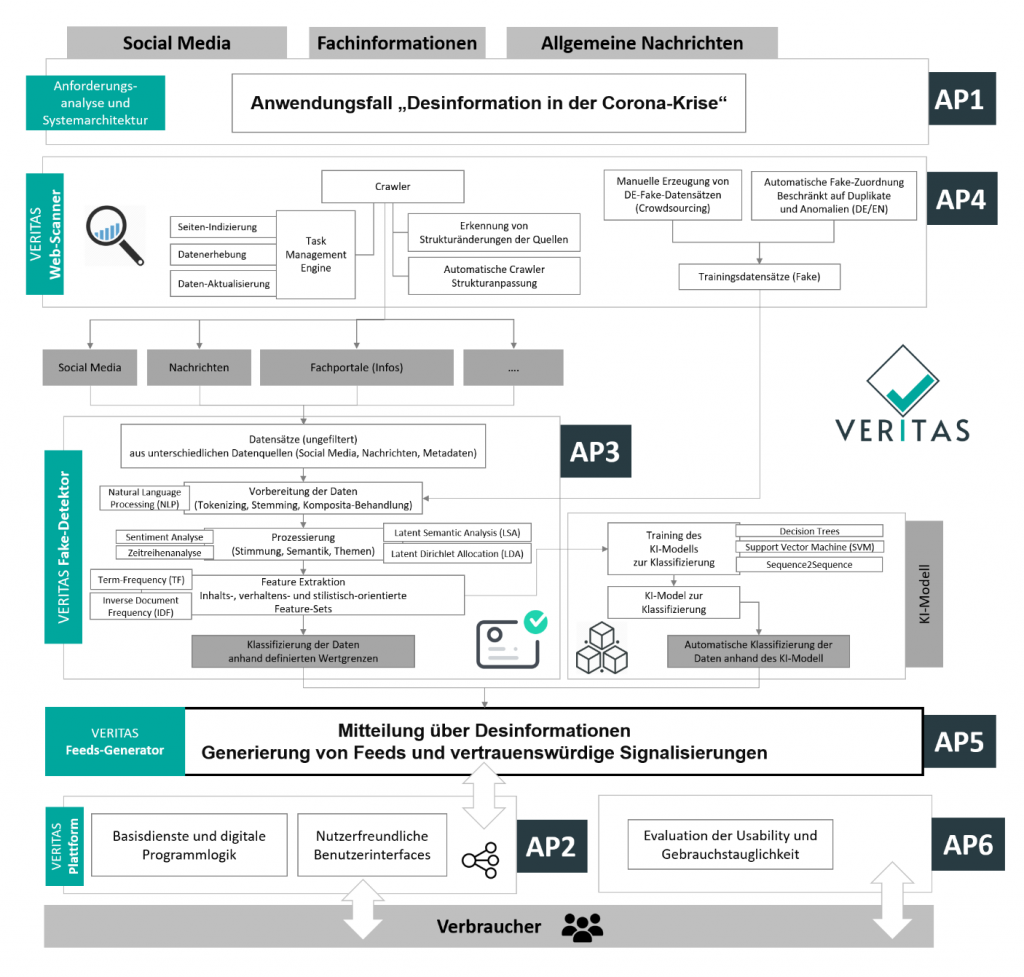

Module der VERITAS Plattform

Ziel dieses Projektes ist die Entwicklung einer webbasierten Plattform samt ihrer Komponenten – VERITAS-Fake-Detektor, VERITAS-Web-Scanner, VERITAS-Feeds-Generator sowie VERITAS-Basisdiente, Interaktionskomponenten und Benutzerinterfaces.

VERITAS-Plattform

Die Softwarearchitektur der webbasierten Plattform basiert auf dem Client-Server-Modell. Sobald der Nutzer*innen die Überprüfung durch das Eingeben einer einzelnen URL oder Textpassage (bspw. Nachrichten- und Kommentarinhalte) initiiert, werden die Frontend-Module angesprochen, um die Abfrage an den Server zu senden. Dort wird durch verschiedene Dienste der Plattform die Anfrage vorverarbeitet (z. B. Transformation in vordefinierte Formate). Wenn die Ergebnisse vom Server (Backend-Modul) zurückgegeben werden, werden durch einen weiteren Dienst (ein anderes JavaScript-Modul) die Ergebnisse in ein wohldefiniertes Format überführt und angezeigt. Der Server übergibt die Analyse an den VERITAS-Fake-Detektor und VERITAS-Web-Scanner. Diese kommunizieren ihre Ergebnisse an VERITAS-Feeds-Generator.

VERITAS-Fake-Detektor

Hier wird die Sucheingabe auf ihren Desinformationscharakter überprüft. Für die Erkennung gefälschter Nachrichten können kognitive, visuelle, affektive und verhaltensbezogene Hinweise in Betracht gezogen werden, bspw. fortlaufende Großschreibung, übermäßige Verwendung von Interpunktion, falsche Interpunktion am Ende der Sätze, übermäßiger Gebrauch von Emoticons und aufmerksamkeitsstarke Emoticons, Standard-Account-Image, das Fehlen eines offiziellen Kontosiegels (insbesondere bei Prominenten), Bilder wie Fotomontagen. Rhetorische Überzeugungsstile, wie z.B. „als Journalist habe ich noch nie so viele leidende Kinder gesehen“, können im Übermaß in Desinformationen enthalten sein. Genauigkeit und Geschwindigkeit des Detektors sind entscheidend für seinen Erfolg.

VERITAS-Web-Scanner

Der VERITAS-Web-Scanner dient dazu, die unterschiedlichen Plattformen hinsichtlich relevanter Informationen abzufragen und die dort enthaltenen Informationen zu extrahieren. Dank konzeptspezifischen Suchalgorithmen bleibt bei der Suche auf der einen Seite der inhaltliche Bezug erhalten und wird auf der anderen Seite die Kontroversität der zu extrahierenden Inhalte sichergestellt. Sukzessive wird in dem Projekt ein großer Trainingsdatensatz aufgebaut, der entscheidend ist für die erfolgreiche Anwendung der Machine Learning (ML)-Algorithmen.

VERITAS-Feeds-Generator

Die Ergebnisse des VERITAS-Fake-Detektors und VERITAS-Web-Scanners werden aufeinander bezogen zusammengeführt, strukturiert und einheitlich aufbereitet und visualisiert, um die Interpretation der Ergebnisse zu erleichtern. So können die Nutzer*innen bspw. sofort sehen, wenn z.B. ein Social Media Beitrag sehr ähnlich zu einem Beitrag in einem Verschwörungstheorie-Forum ist. Dank konzeptspezifischer Ranking-Algorithmen können Endnutzer*innen die wichtigsten Inhalte zuerst sehen.

VERITAS-Basisdiente, Interaktionskomponenten und Benutzerinterfaces

Die Verwendung weit verbreiteter und vertrauter Gestaltungsmittel für webbasierte Basisdienste, Interaktionskomponenten sowie Benutzeroberflächen erleichtert es den Nutzer*innen die VERITAS-Plattform in ihrem Alltag ohne jegliche Akzeptanzhürden zu benutzen.

Kommunikation von Desinformation

Die VERITAS-Plattform ermöglicht verschiedene Formate der Sucheingabe inkl. Volltextsuche (bspw. URLs oder einzelne Textpassagen) und einheitliche Formate bei der Präsentation inkl. Layout und Design aller Meldungen.

VERITAS-konzeptspezifische Suchalgorithmen sorgen für die Kontroversität der Suchergebnisse. Die extrahierten Informationen werden über Ähnlichkeitsmaße aufeinander bezogenen und veranschaulicht, so dass die Nutzer*innen sofort sehen können, wenn z.B. ein Social Media Beitrag sehr ähnlich zu einem Beitrag in einem Verschwörungstheorie-Forum ist. Für eine möglichst gute User Experience und Usability können Nutzer*innen auf Grundlage von VERITAS-konzeptspezifischen Feeds-Ranking-Algorithmen die wichtigsten und auf ihren Informationsgehalt hin verifizierten Inhalte zuerst sehen.

Den sogenannten Faktenprüfer*innen und Wächter*innen, die Fehlinformationen und falsche Nachrichten in Online-Diskussionen korrigieren, indem sie auf URLs zur Überprüfung von Fakten verweisen, wird mit VERITAS ein neuartiges Empfehlungsmodell von Nachrichteninhalten und URLs zur Überprüfung von Fakten vorgelegt, um ihnen die Arbeit zu erleichtern. Faktenprüfer*innen brauchen in der Regel weniger als einen Tag, um auf Behauptungen in Online-Gesprächen zu antworten, und einen weiteren Tag, um verifizierte Informationen an Hunderte Millionen Anhänger*innen zu verbreiten. Sie können die Ergebnisse der VERITAS-Überprüfung über auf Crowdsourcing ausgelegte Ansätze zur Eindämmung der Verbreitung von Desinformationen weiterverwenden.

Für alle Branchen geeignet

Der VERITAS-Ansatz ist generisch und erlaubt auch eine Nutzung im Kontext anderer medizinischer Anwendungsfälle sowie auch durch andere Branchen und Zielgruppen außerhalb des Gesundheitswesens. Fehlinformationen werden auch im politischen Bereich vorsätzlich lanciert und verbreiten sich hier sogar mit einer höheren Geschwindigkeit als in anderen Bereichen. Fehlinformationen können wirtschaftlichen Schaden anrichten und der Gesellschaft insgesamt schaden, indem sie Panik und selbst bewaffnete Konflikte auslösen sowie kriminelle Aktivitäten unterstützen.

Wegen der hohen Verbreitung von Fehlinformationen durch soziale Medien in humanitären Krisen sollte in weiteren Ausbaustufen der VERITAS-Plattform auch der Bereich der zivilen Sicherheit adressiert werden (z.B. Katastrophenmanagement, öffentliche Informationskampagnen, etc.).

Die VERITAS-Plattform eignet sich ebenso hervorragend für die Informationsvalidierung für Wissenschaftlicher*innen und Journalisten bei notwendigen aufwändigen fach- und themenbezogenen Literatur- bzw. Nachrichtenrecherchen zur Validierung der Informationsquellen.

Projektförderung und Projektpartner

Forschung Agil – Erkennen und Bekämpfung von digitalen Desinformationskampagnen.

Gegenstand der Förderung ist die Erforschung und Entwicklung von Methoden und Technologien sowie die Analyse gesellschaftlicher und rechtlicher Rahmenbedingungen, um die massenhafte Verbreitung von Desinformationen besser zu verstehen und ihr potenziell entgegenwirken zu können. Die Zahl bewusst verbreiteter Falschmeldungen im Internet und den Sozialen Medien nimmt seit Jahren immer weiter zu. Häufig ist das Motiv, Angst und Verunsicherung zu schüren oder das Vertrauen in die Politik zu erschüttern. Fake News werden dabei immer professioneller verbreitet. Ihr Inhalt reicht von harmlosen Scherzen bis hin zu Informationen, die Menschenleben gefährden können – etwa im Zusammenhang mit dem Coronavirus. Das Bundesforschungsministerium sieht in Fake News eine zunehmende Gefahr für die Demokratie und den gesellschaftlichen Zusammenhalt. Deshalb fördert das BMBF nun zehn neue Projekte, in denen Wissenschaftlerinnen und Wissenschaftler Fake News und andere Formen der Desinformation erforschen, um Gegenmaßnahmen zu entwickeln. Weitere Förderprojekte…

Co-Autoren

Dr. Tatiana Ermakova

Fraunhofer Institute for Open Communication Systems (FOKUS)

Kaiserin-Augusta-Allee 31 | 10589 Berlin

Dr. Michael John

Fraunhofer Institut für Offene Kommunikationssysteme (FOKUS)

Kaiserin-Augusta-Allee 31 | 10589 Berlin